AI 에이전트가 개발 워크플로의 핵심으로 자리 잡으면서 기업들에게는 기능만큼이나 중요한 기준이 생겼습니다. 바로 “AI를 어디까지 믿고 맡길 수 있는가?"라는 질문입니다.

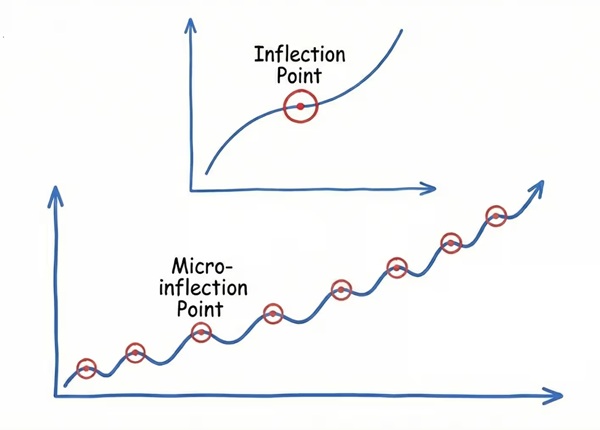

GitLab은 기업 환경에서 AI 에이전트를 사용하는 13개 조직을 대상으로 심층 연구를 진행했습니다. 그 결과 AI에 대한 신뢰는 단 한 번의 성능 입증이 아니라 일상 업무 속에서 반복되는 '미세한 변곡점(Micro-inflection points)'이 쌓여 만들어진다는 것을 확인했습니다. 이번 콘텐츠에서는 GitLab의 연구 결과를 바탕으로 성공적인 DevSecOps 환경을 위해 AI 에이전트가 갖춰야 할 4가지 신뢰 요소를 정리해 드립니다.

출처=GitLab

❤️신뢰는 ‘한 번’이 아닌 ‘누적’의 결과입니다

기존 소프트웨어는 예측 가능한 동작으로 신뢰를 쌓았다면 자율성을 가진 AI 에이전트는 필연적으로 불확실성을 동반합니다. 사용자는 에이전트가 자신의 상황을 이해하고, 설정된 규칙을 준수하며, 워크플로를 개선하는 과정을 반복적으로 경험할 때 비로소 AI를 ‘신뢰할 수 있는 동료’로 받아들입니다. 특히 사소한 실수가 비즈니스 전반에 큰 영향을 줄 수 있는 DevSecOps 환경일수록 이러한 점진적인 신뢰 구축 과정은 선택이 아닌 필수입니다.

📋AI 에이전트 신뢰를 구성하는 4가지 핵심 요소

GitLab 연구팀은 사용자 신뢰를 결정짓는 4가지 핵심 변곡점을 다음과 같이 제시합니다.

출처=GitLab

① 보호 조치(Safeguards)

사용자는 시스템에 돌이킬 수 없는 피해를 주지 않을 것이라는 확신이 필요합니다. 데이터 삭제 등 중요한 작업 전 명시적 승인 요청, 문제 발생 시 롤백 기능, 정책 준수를 위한 안전 장치가 필수적입니다.

② 투명성 제공(Transparency)

블랙박스처럼 결과만 보여주는 시스템은 신뢰하기 어렵습니다. 실시간 진행 상황을 공유하고, 실행 전 계획된 접근 방식을 설명하며, 오류 시 명확한 복구 경로를 안내해야 합니다.

③ 맥락을 기억하는 능력(Context Awareness)

같은 정보를 반복해서 입력하게 하는 것은 신뢰를 갉아먹는 지름길입니다. 사용자의 코딩 스타일, 프로젝트별 요구 사항, 수정 사항 등을 기억하고 학습하여 개인화된 경험을 제공해야 합니다.

④ 필요를 예측하는 능력(Anticipating Needs)

AI가 수동적인 도구를 넘어 능동적인 파트너가 될 때 신뢰는 강화됩니다. 사용자의 작업 패턴을 인식하고 적합한 전문 에이전트를 자동으로 선택하는 등 인지 부하(cognitive load)를 줄여주는 기능이 포함되어야 합니다.

🔑실무자를 위한 AI 에이전트 구현 전략

조직 내에 AI 에이전트를 안정적으로 안착시키기 위해 GitLab은 다음과 같은 실무 지침을 권장합니다.

✔️점진적 확장: 위험도가 낮은 작업부터 시작하여 활용 범위를 넓히세요.

✔️개입 설계: 에이전트가 스스로 멈추고 사람의 판단을 기다려야 할 지점을 명확히 하세요.

✔️감사 체계: 모든 활동을 추적할 수 있는 투명한 로그 시스템을 유지하세요.

✔️개인화: 팀과 사용자의 워크플로에 맞춘 맞춤형 경험을 설계하세요.

AI 에이전트 도입의 핵심은 기술력 그 자체보다 '신뢰를 전제로 한 설계와 운영'에 있습니다.

단 한 번의 중대한 실패가 공들여 쌓은 신뢰를 무너뜨릴 수 있으므로 모든 상호작용에서 일관된 경험을 제공하는 것이 중요합니다.

🔗[GitLab 원문 보기]

플래티어는 GitLab의 전략적 파트너로서 단순한 솔루션 공급을 넘어 투명성·제어·안전성을 갖춘 진정한 에이전틱 DevSecOps 환경 구축을 지원합니다.

우리 조직에 꼭 맞는 신뢰 기반 AI 워크플로를 지금 플래티어와 함께 고민해 보시기 바랍니다.

이 포스팅이 도움이 되셨나요? 플래티어는 기업의 디지털 전환을 돕는 최적의 솔루션을 제안합니다.

관련하여 궁금하신 점은 언제든지 문의해 주세요😊